Was als Experiment begann, ist nun fester Bestandteil des Redaktionsplans der Hamburg Open Online University. Die Journalistin Meena Stavesand und Social-Media-Managerin Katrin Schröder berichten im Gastbeitrag über ihre Erfahrungen mit KI-generierten Wissenschaftler*innen auf TikTok und über die Chancen, aber auch Grenzen, die es dabei für die Wissenschaftskommunikation gibt.

TikTok und die Ära der KI-Avatare

TikTok – eine Plattform, die von Algorithmen und Memes bestimmt wird und ständig im Wandel ist. Wie lässt sich dort Wissenschaft kommunizieren? Diese Frage stellten wir uns im Kommunikationsteam an der Hamburg Open Online University (HOOU). Als im November 2022 intuitive KI-Tools wie ChatGPT, Midjourney und Dall-E bei TikTok Einzug hielten, sah man plötzlich eine neue Art von Clips. Historische Figuren sprachen über sich und geschichtliche Ereignisse. Dabei handelte es sich um Animationen, die mithilfe von KI-Tools generiert wurden. Fans prominenter Musiker*innen und Schauspieler*innen wurden davon ebenso angesprochen wie Interessierte an Geschichte und Wissenschaft.

Zwei Dinge haben uns fasziniert: die Arbeit mit KI, um unsere Kompetenzen in diesem Zukunftsthema zu stärken, und die Viralität von Wissenschaftsinhalten. Anders gesagt: Wir wollten herausfinden, ob populärer Videocontent mit akademisch fundiertem Wissen funktionieren würde. Denn Factchecking und damit Qualitätskontrolle gab es bei diesen neuen viralen Videos meist nicht. Und so begann unser Experiment. Da wir eine Bildungsinitiative der Hamburger Hochschulen, dem Multimedia Kontor Hamburg und der Freien und Hansestadt Hamburg sind, konnten wir in den vergangenen Jahren auf einen großen Fundus von Videos zurückgreifen, in denen Wissenschaftler*innen unter anderem der TU Hamburg, der Hochschule für Angewandte Wissenschaften Hamburg oder des Universitätsklinikums Hamburg-Eppendorf ihre Forschung vorstellten. Diese Videos funktionieren auf TikTok und erreichen bis zu 150.000 Views, aber viral war keines.

Würde uns das mit den KI-Avataren gelingen? Bevor wir die ersten Animationen erstellten, haben wir uns mit dem rechtlichen Rahmen und der ethischen Grundlage von KI-Avataren beschäftigt.

Rechtlicher Rahmen und ethische Grundlagen

Transparenz ist für uns das oberste Gebot, weswegen wir unter jedem KI-animierten Video den Hinweis setzen: „Video und Text wurden mit Künstlicher Intelligenz erstellt.“ Wir folgen dabei dem Entwurf der KI-Verordnung (dem sogenannten AI-Act): Nutzer*innen eines KI-Systems, das Bild-, Ton- oder Videoinhalte erzeugt oder manipuliert, die wirklichen Personen, Gegenständen, Orten oder anderen Einrichtungen oder Ereignissen merklich ähneln und einer Person fälschlicherweise als echt oder wahrhaftig erscheinen würden („Deepfake“), müssen offenlegen, dass die Inhalte künstlich erzeugt oder manipuliert wurden. Außerdem generieren wir aus rechtlichen Gründen Avatare von Persönlichkeiten, die seit mehr als 30 Jahren tot sind. Dabei achten wir zudem darauf, den Respekt vor den dargestellten historischen Persönlichkeiten zu wahren.

Neben der rechtlichen Ebene ist uns auch der ethische Umgang mit KI wichtig. Wir führen ein strenges Factchecking der von den KI-Avataren vermittelten Informationen durch, um keine Falschinformationen zu verbreiten. Außerdem achten wir auf eine angemessene, zur Person passende Sprache. Wir sind uns bewusst, dass KI-Modelle bestimmte Verzerrungen enthalten und daher ein sensibler Umgang mit den generierten Avataren notwendig ist. Da insbesondere die Bildqualität von KI-Tools immer besser wird, erkennen Menschen möglicherweise einen KI-Avatar nicht mehr als solchen. Das macht den Transparenzhinweis umso wichtiger.

KI-Avatare in der Wissenschaftskommunikation

Wir sind der Meinung, dass die KI-Avatare verstorbener Wissenschaftler*innen eine Brücke zwischen Vergangenheit und Gegenwart schlagen können. Die Avatare geben Einblicke in die Entstehung wichtiger Theorien, Entdeckungen und Arbeiten. Nach ersten positiven Rückmeldungen aus unserer Community greifen wir nun immer wieder auf die KI-Avatare zurück, um auf Gedenktage, aktuelle Nachrichten oder gesellschaftliche Phänomene zu reagieren. Der Einsatz der KI-Technologie in der Wissenschaftskommunikation eröffnet uns neue Wege, um komplexe Themen zu vermitteln. Wir schaffen mit den Videos einen niederschwelligen Zugang zu weiterführenden Informationen. Wir können viel Wissen in kurzer Zeit vermitteln und auch jüngere Generationen an universitäre Bildung heranführen. Die Umsetzung ist kostengünstig, die verwendeten Tools teils kostenfrei, teils für einen geringen monatlichen Betrag zu buchen.

So funktioniert die Erstellung der KI-Avatare

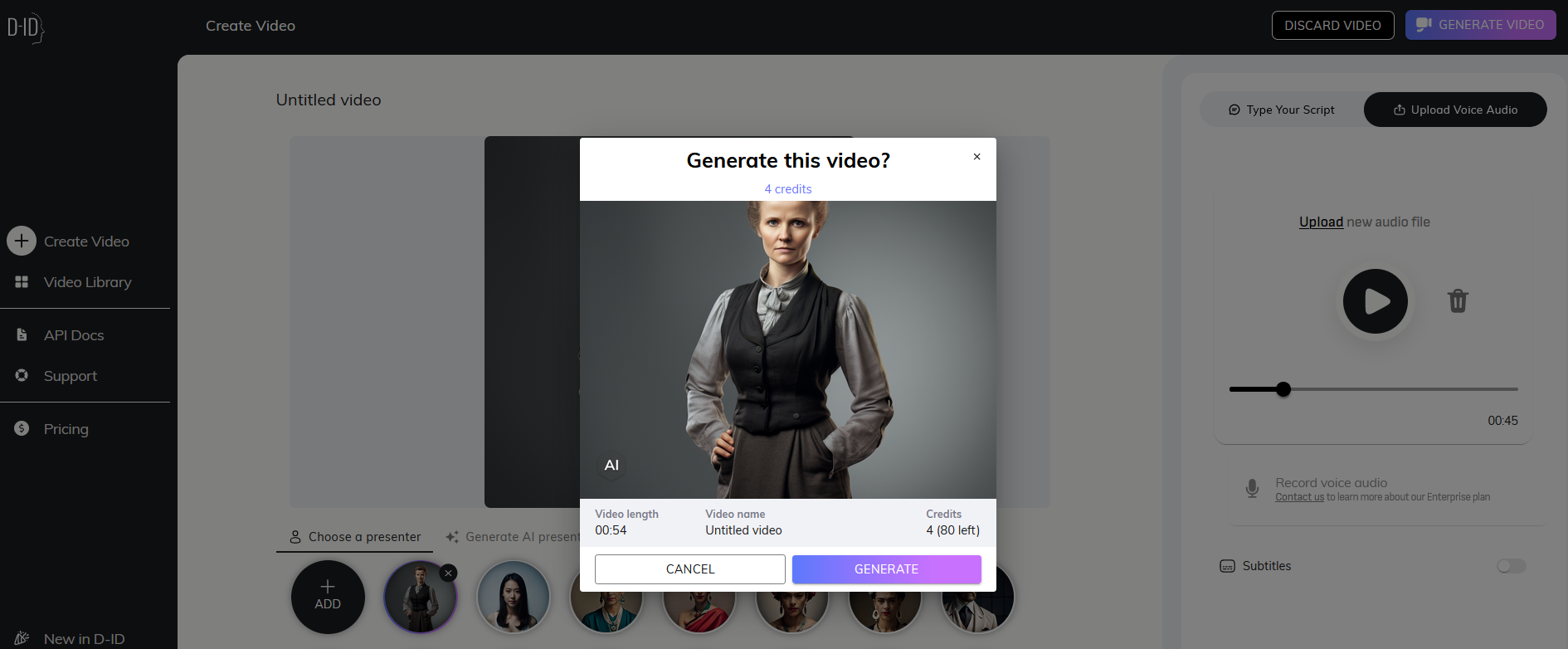

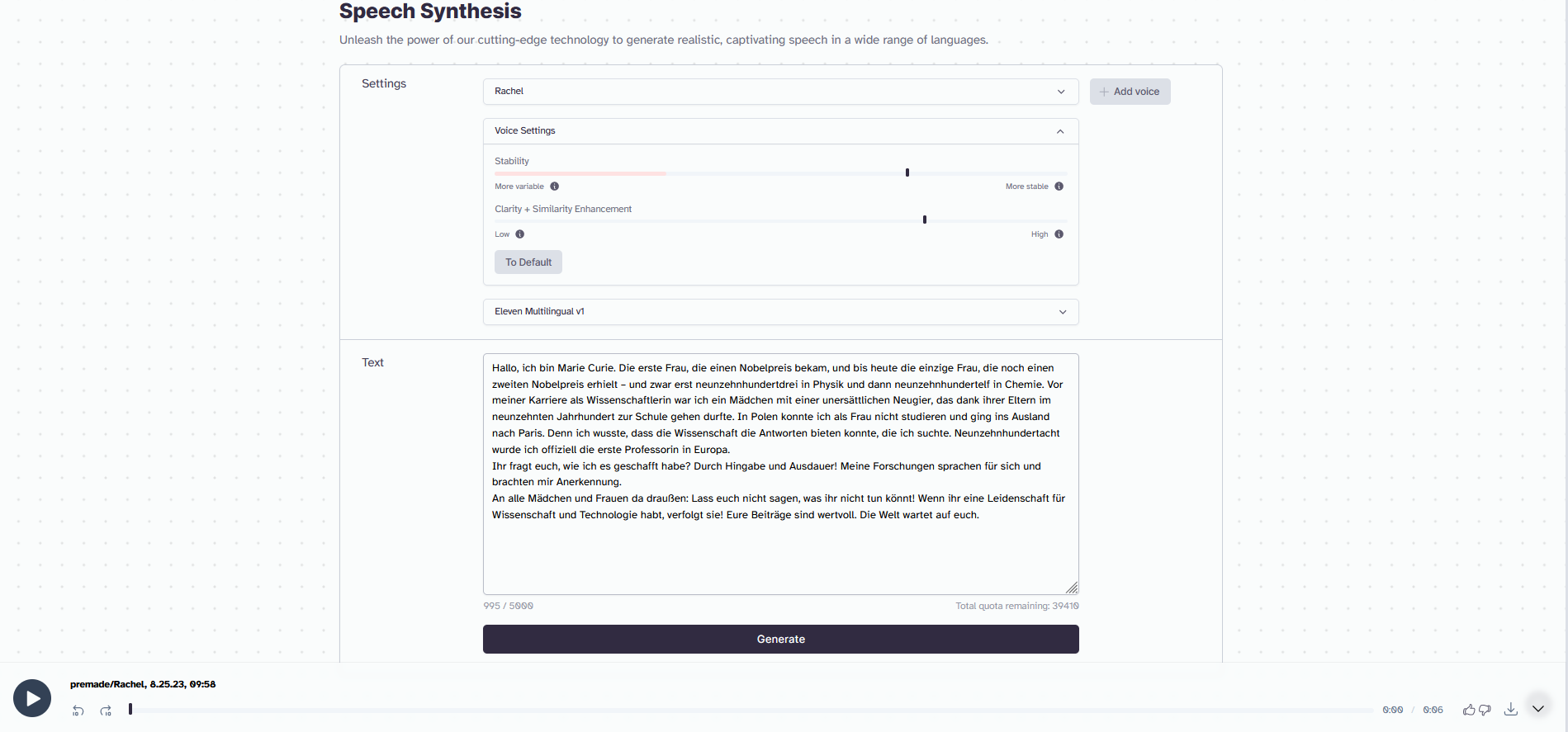

Wir lassen von ChatGPT einen Text schreiben, der das Leben und Wirken der Person beschreibt. Dann prüfen wir die Fakten, formulieren gegebenenfalls um oder ergänzen Informationen. Dabei achten wir darauf, dass der Text nach mündlicher Sprache klingt. Mit den Bildgeneratoren Midjourney oder LeonardoAI lassen wir das Bild der Person erstellen. Anschließend werden Text und Bild bei D-ID zusammengesetzt. Außerdem wählen wir eine passende Stimme aus. Falls sich die Stimmen nicht eignen, weichen wir auf ElevenLabs aus.

Die Watchtime zeigt bereits nach kurzer Testdauer unserer KI-Avatare, dass dieser Videocontent funktioniert – das Video mit Marie Curie hat eine Watchtime von knapp 24 Stunden bei 59.608 Views, 1030 Likes, 21 Kommentaren und 34 Shares (Stand: 31.1.24). Durch die persönlichen Erzählungen der Wissenschaftler*innen wirkt der Content lebendig und nahbar. So konnten wir durch knapp 20 KI-Avatare eine höhere Reichweite, Aufmerksamkeit und ein gesteigertes Interesse für wissenschaftliche Themen wahrnehmen. Letzteres spiegelt sich insbesondere durch Kommentare der Community wider. Unter dem Video von Frida Kahlo beispielsweise bewunderten viele ihre Kunst. Wir haben auch Reaktionen auf die Produktion der KI-Avatare erhalten. TikTok Nutzer*innen, aber auch Hochschulmitarbeiter*innen, die uns direkt anschreiben, möchten wissen, wie wir diese produzieren.

Umgang mit Stitches

Plattformen wie TikTok sind darauf ausgelegt, dass Videos weiterverbreitet werden. Die Plattform lebt von Partizipation. Das finden wir wünschenswert; wir möchten, dass unsere Nutzer*innen unsere wissenschaftlichen Informationen in Form von Stitches weiterverwenden. Die Stitches-Funktion erlaubt, ein anderes Video auf TikTok mit einem von einem selbst erstellten Video zu kombinieren. Das macht für uns Dialog und Debatte aus – vor allem im wissenschaftlichen Kontext. Durch diesen authentischen Dialog erreichen wir eine junge Zielgruppe. Sollte jemand ein Video in einem falschen Kontext darstellen, haben wir die Möglichkeit, diesen Inhalt zu melden und in Kommentaren beziehungsweise als Videoantwort darauf zu reagieren, indem wir die Fakten aufzeigen.

Sieben Learnings

- Wir erreichen mit dem niederschwelligen Bildungscontent eine junge Zielgruppe.

- Wir müssen bei der Erstellung von Inhalten umsichtig vorgehen, um den gängigen ethischen Richtlinien zu folgen.

- Die Faktenprüfung des Inhalts nach journalistischen Standards ist obligatorisch.

- Die TikTok-Videos sind ein idealer Einstieg für eine tiefergehende thematische Auseinandersetzung – diese bieten wir auf unserer eigenen Plattform hoou.de.

- Ein Austausch zwischen der Redaktion und der TikTok-Community finden wir sinnvoll. Wir legen auch großen Wert darauf, dass sich die Wissenschaftler*innen an den Hochschulen in die Produktion einklinken.

- Bei aller Euphorie für das Format dürfen die Herausforderungen, die diese Art von Content mit sich bringt, nicht vergessen werden. Welche Inhalte in welcher Weise und von welcher Persönlichkeit kommuniziert werden, muss immer eine Einzelfallentscheidung bleiben.

- Die KI-Avatare sind bereits in der Hochschullandschaft auf Interesse gestoßen, so dass wir bereits Schulungen anbieten.

Die redaktionelle Verantwortung für diesen Beitrag lag bei Anna Henschel. Gastbeiträge spiegeln nicht zwangsläufig die Meinung unserer Redaktion wider.